Python網絡爬蟲開發從入門到精通 網絡技術開發的利器

Python網絡爬蟲開發,作為網絡技術開發中一項極具實用價值的技能,正隨著互聯網數據的爆炸式增長而愈發重要。從簡單的數據抓取到復雜的自動化采集系統,掌握Python爬蟲技術意味著能夠高效地從互聯網上獲取、分析和利用海量信息。本文將從入門基礎到進階精通,系統性地介紹Python網絡爬蟲的開發路徑與核心技術。

一、入門基礎:環境搭建與請求發送

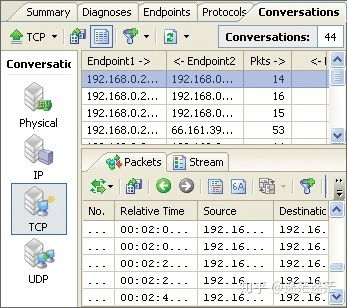

對于初學者而言,首先需要搭建Python開發環境,并安裝必要的庫,如requests、BeautifulSoup等。理解HTTP/HTTPS協議的基本原理是爬蟲開發的基石,包括GET/POST請求、請求頭(User-Agent、Cookie等)和狀態碼。通過requests庫發送簡單的HTTP請求,獲取網頁的HTML源代碼,是爬蟲的第一步。學習使用瀏覽器開發者工具(如Chrome DevTools)分析網頁結構,識別數據所在標簽,為后續解析做好準備。

二、數據解析:從HTML到結構化信息

獲取原始HTML后,需要從中提取目標數據。BeautifulSoup和lxml是兩種常用的解析庫,它們支持通過標簽名、類名、ID或CSS選擇器來定位元素。初學者應熟練掌握BeautifulSoup的find()和find_all()方法,以及如何獲取元素的文本、屬性。對于動態加載的網頁(數據通過JavaScript異步加載),簡單的靜態解析可能無效,此時需要了解Ajax請求或考慮使用Selenium、Playwright等工具模擬瀏覽器行為來渲染頁面。

三、進階技巧:應對反爬與效率優化

隨著爬蟲規模擴大,會遇到網站的反爬蟲機制,如IP封鎖、驗證碼、請求頻率限制等。進階開發需掌握以下技術:

1. 請求頭模擬與用戶代理輪換,偽裝成真實瀏覽器訪問。

2. 使用代理IP池,分散請求以避免IP被封。

3. 處理Cookies和Session,維持登錄狀態。

4. 設置請求延遲(如time.sleep)或使用異步庫(如aiohttp)提高效率,同時尊重網站的robots.txt協議。

5. 對于驗證碼,可嘗試OCR識別或使用第三方打碼服務。

學習使用Scrapy框架可以大幅提升開發效率,它提供了完整的爬蟲工作流管理,包括請求調度、數據管道和中間件支持。

四、精通實踐:項目架構與數據管理

精通爬蟲開發意味著能構建健壯、可維護的系統。這包括:

- 設計分布式爬蟲,利用多線程、多進程或分布式框架(如Scrapy-Redis)實現高速采集。

- 數據存儲方案,根據需求選擇文件(CSV、JSON)、數據庫(MySQL、MongoDB)或云存儲。

- 錯誤處理與日志記錄,確保爬蟲長期穩定運行,并能從異常中恢復。

- 數據清洗與預處理,使用pandas等庫將原始數據轉化為可用格式。

- 遵守法律法規與倫理規范,只抓取公開數據,避免侵犯隱私或網站服務條款。

五、網絡技術開發的融合應用

Python爬蟲不僅是獨立工具,更能與其他網絡技術結合,賦能更廣泛的開發場景。例如:

- 與Web開發結合,自動采集內容更新網站。

- 與數據分析結合,為機器學習模型提供訓練數據。

- 與監控系統結合,實時追蹤價格、新聞或社交媒體趨勢。

通過持續實踐,如從簡單新聞站點到復雜電商平臺的全棧爬蟲項目,開發者可以深化對網絡協議、并發編程和數據工程的理解,真正從入門走向精通。

Python網絡爬蟲開發是一條從基礎請求到系統架構的成長之路。它要求開發者不僅會寫代碼,更要懂網絡、懂數據、懂倫理。掌握這門技術,你將在網絡技術開發領域獲得強大的數據獲取能力,為創新應用打下堅實基礎。

如若轉載,請注明出處:http://www.dgmingyue.cn/product/78.html

更新時間:2026-04-11 02:17:05